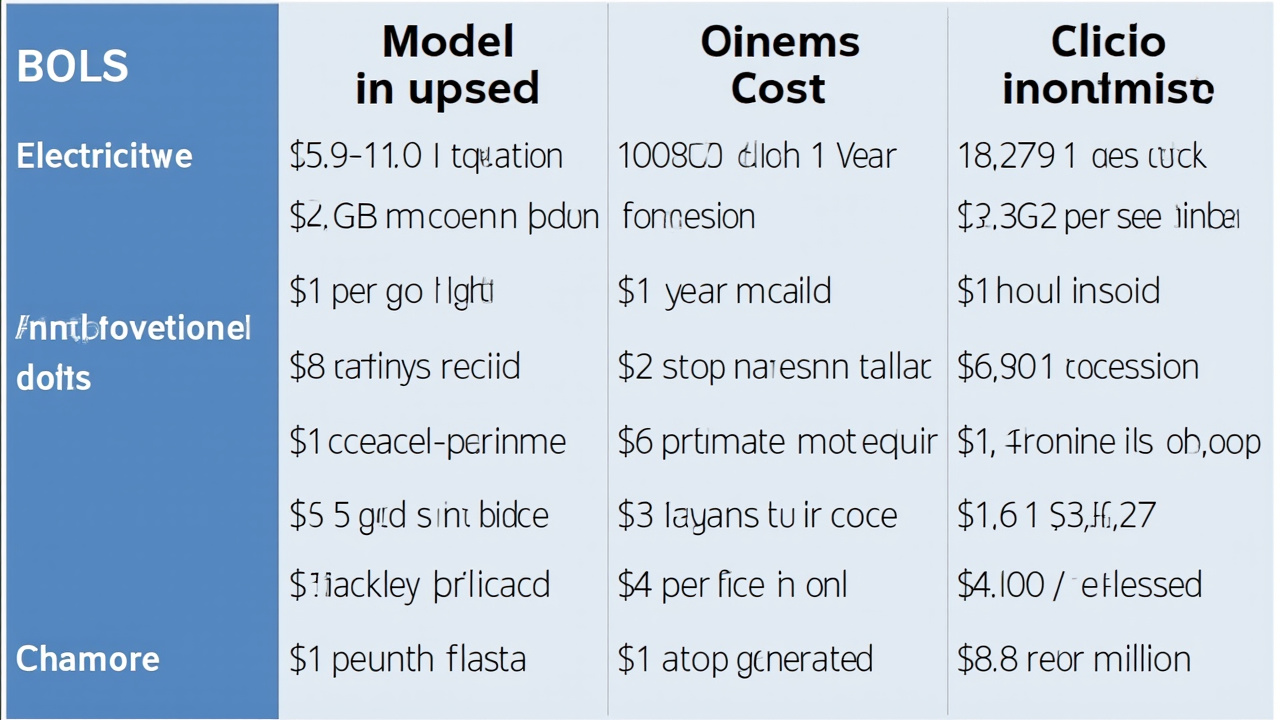

Ejecutar LLMs en Mac con chip M5 vs OpenRouter: análisis de costos

Este artículo analiza la viabilidad económica de ejecutar modelos de lenguaje grandes (LLM) de manera local en un MacBook Pro con chip M5, comparándolo con servicios de inferencia en la nube como OpenRouter. El autor realiza un desglose detallado considerando tres factores principales: electricidad,