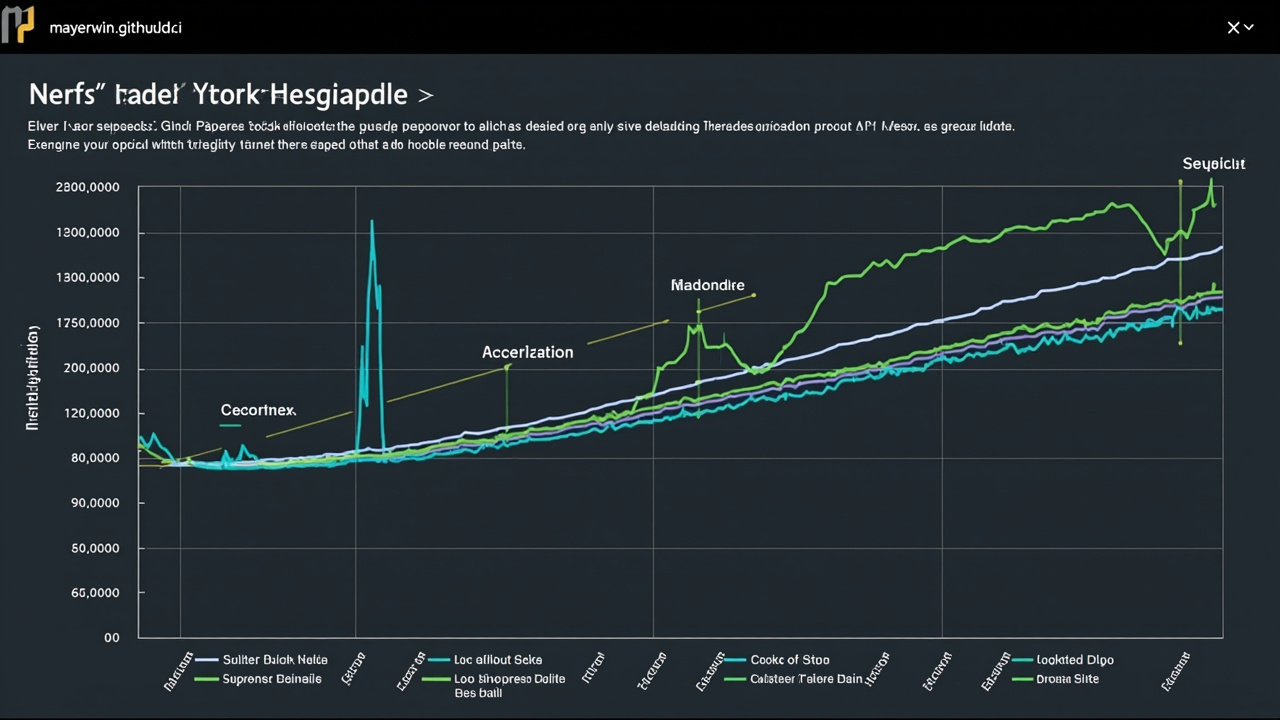

Una nueva herramienta de seguimiento permite visualizar los 'nerfs' o debilitamientos que los laboratorios de inteligencia artificial implementan en sus modelos tras el lanzamiento oficial. El sistema, disponible en mayerwin.github.io, rastrea automáticamente el rendimiento de los modelos líderes de cada compañía mediante datos diarios del LM Arena Leaderboard, que se basa en miles de evaluaciones humanas ciegas y colectivas. La herramienta muestra cómo actualizaciones posteriores pueden introducir cambios como censura agresiva, cuantización excesiva para reducir costos computacionales, o degradación del comportamiento. Cada laboratorio tiene una sola curva que representa su modelo insignia mejor posicionado en cada momento, evitando fluctuaciones entre variantes de razonamiento. Los proveedores también pueden cambiar silenciosamente a versiones cuantizadas durante picos de demanda, debilitando el rendimiento sin advertencia. Esta visualización permite identificar tendencias de degradación en el ciclo de vida de los modelos y comparaciones directas entre laboratorios.

Nueva herramienta web detecta nerfs ocultos en modelos de inteligencia artificial